Chatbot Geschichte: Von ELIZA bis zum KI-Verkaufsberater

Entdecke die faszinierende Chatbot Geschichte: Von ELIZA über NLP Chatbots bis zu modernen KI-Assistenten, die heute als Produktberater überzeugen.

Von einfachen Tricksystemen zu KI-Verkaufsberatern

Die Chatbot Geschichte hat in den letzten Jahrzehnten eine beeindruckende Reise zurückgelegt. Von den ersten regelbasierten Systemen bis hin zu den heutigen KI-gestützten Assistenten hat sich die Art und Weise, wie wir mit Maschinen kommunizieren, grundlegend verändert. Dabei ging es nicht nur um technologischen Fortschritt – es war eine Evolution mit drei deutlich unterscheidbaren Phasen: Vom Simulator, der Menschen täuschen wollte, über den Bibliothekar, der Informationen abrief, bis hin zum Berater, der heute komplexe Probleme löst und Kunden aktiv beim Kauf unterstützt.

Chatbots sind mittlerweile ein integraler Bestandteil der modernen Kommunikation geworden. Sie unterstützen Unternehmen bei der Kundenbetreuung, erleichtern den Zugang zu Informationen und bieten personalisierte Erlebnisse für Nutzer auf der ganzen Welt. Wer heute einen KI-Chatbot einsetzt, profitiert von Fortschritten in Natural Language Processing, Machine Learning und künstlicher Intelligenz, die die Fähigkeiten von Chatbots enorm erweitert haben.

In diesem Artikel werden wir die faszinierende Evolution der Chatbot-Technologie nachverfolgen. Wir beginnen mit den frühen regelbasierten Systemen, betrachten die Integration von NLP und Machine Learning, analysieren die oft vergessene Frustrations-Phase der 2010er Jahre und enden mit den neuesten KI-gestützten Conversational Interfaces. Dabei werfen wir auch einen Blick auf die Auswirkungen dieser Entwicklung auf Unternehmen und Kunden sowie auf die Zukunftsperspektiven dieser Technologie – insbesondere den Wandel vom reinen Support-Bot zum intelligenten Produktberater.

ELIZA und PARRY – Ziel: Den Menschen täuschen und Gespräche simulieren

Siri, Alexa und FAQ-Bots – Ziel: Informationen abrufen und weiterleiten

Moderne KI-Assistenten – Ziel: Komplexe Probleme lösen und aktiv beraten

Die Anfänge: Können Maschinen denken? (1950-1960)

Bevor wir über die erste praktische Chatbot-Implementierung sprechen, müssen wir die theoretische Grundlage verstehen. Die Chatbot Geschichte beginnt eigentlich bereits 1950 mit einer fundamentalen Frage, die Alan Turing stellte: Können Maschinen denken? Diese Frage führte zur Entwicklung des berühmten Turing-Tests, der bis heute als Maßstab für maschinelle Intelligenz gilt.

Der Turing-Test definiert, dass eine Maschine als intelligent gilt, wenn ein menschlicher Fragesteller nicht unterscheiden kann, ob er mit einem Menschen oder einer Maschine kommuniziert. Dieser theoretische Rahmen legte den Grundstein für alle späteren Chatbot-Entwicklungen – auch wenn das ursprüngliche Ziel Imitation war, nicht Nützlichkeit. Diese Unterscheidung ist wichtig, um die spätere Evolution der Technologie zu verstehen.

Die Geburt der Chatbots: ELIZA und PARRY (1966-1980)

ELIZA: Der erste Chatbot der Geschichte

Die praktische Geschichte der Chatbots beginnt in den 1960er Jahren mit der Entwicklung von ELIZA. Dieses Programm, 1966 von Joseph Weizenbaum am MIT entwickelt, gilt als einer der ersten Versuche, den Turing-Test zu bestehen. Interessanterweise war Weizenbaum ein deutsch-amerikanischer Informatiker, was der Chatbot Geschichte auch einen deutschen Bezug verleiht.

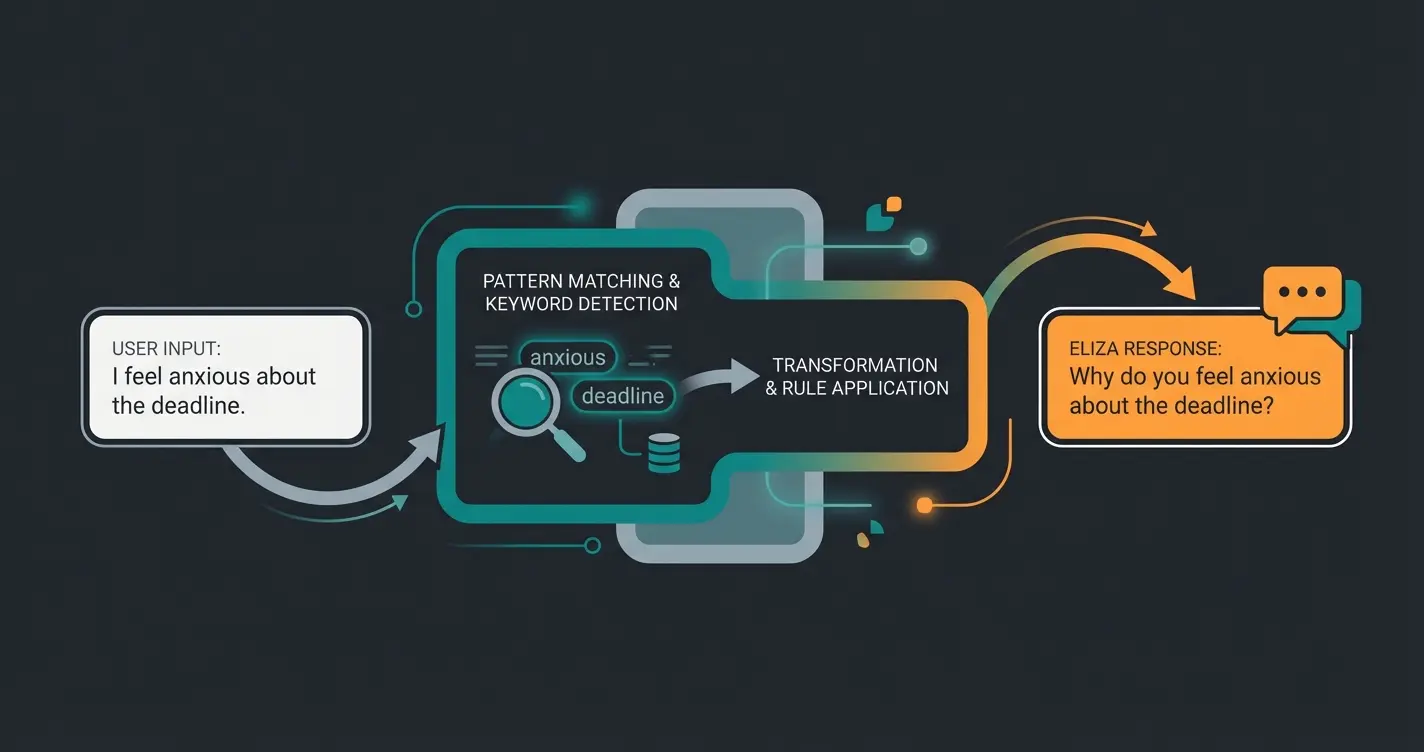

ELIZA simulierte ein Gespräch mit einem Psychotherapeuten, indem sie einfache Muster-Erkennungstechniken verwendete, um Schlüsselwörter aus den Eingaben des Benutzers zu extrahieren und darauf basierend vorgefertigte Antworten zu geben. Wenn der Nutzer beispielsweise Meine Mutter macht mich traurig eingab, erkannte ELIZA das Schlüsselwort Mutter und antwortete mit Erzähle mir mehr über deine Familie.

Das Faszinierende an ELIZA war, dass viele Nutzer dem Programm echte Emotionen und Verständnis zuschrieben – obwohl es technisch gesehen nur Schlüsselwörter erkannte und vorgefertigte Phrasen zurückgab. Dieser ELIZA-Effekt zeigt, wie bereitwillig Menschen bereit sind, Maschinen menschliche Eigenschaften zuzuschreiben.

PARRY: Der erste Chatbot mit Persönlichkeit

Ein weiterer bedeutender Meilenstein war PARRY, entwickelt 1972 von Kenneth Colby an der Stanford University. PARRY simulierte das Verhalten eines Patienten mit Schizophrenie und war in seiner Funktionsweise komplexer als ELIZA. Während ELIZA einfach Fragen zurückspiegelte, hatte PARRY ein rudimentäres Emotions-Modell mit Variablen für Angst, Wut und Misstrauen.

In einem berühmten Experiment wurden PARRY und ELIZA miteinander verbunden – sie führten ein Gespräch miteinander, das heute noch als kurioses Artefakt der Chatbot Geschichte gilt. Beide Systeme basierten jedoch auf vordefinierten Regeln und Mustern, was ihre Flexibilität und Anpassungsfähigkeit stark einschränkte.

Limitierungen der ersten Chatbot-Generation

Trotz ihrer bahnbrechenden Natur hatten diese frühen Chatbots erhebliche Einschränkungen. Der Pattern-Matching-Ansatz, den ELIZA und PARRY verwendeten, war zwar innovativ, aber auch sehr begrenzt. Diese Systeme konnten nur auf vordefinierte Eingabemuster reagieren und hatten kein echtes Verständnis für den Kontext oder die Bedeutung der Gespräche.

Die Hauptlimitierungen der ersten Chatbot-Generation waren:

- Fehlende Flexibilität: Die Chatbots konnten nur auf vorprogrammierte Fragen und Szenarien reagieren.

- Kein Kontextverständnis: Sie konnten den breiteren Kontext eines Gesprächs nicht erfassen oder darauf reagieren.

- Begrenzte Lernfähigkeit: Die Systeme konnten nicht aus Interaktionen lernen oder sich an neue Situationen anpassen.

- Oberflächliche Antworten: Oft gaben sie allgemeine oder ausweichende Antworten, wenn sie eine Eingabe nicht verstanden.

- Kein Gedächtnis: Jede Nachricht wurde isoliert betrachtet, ohne Bezug zu vorherigen Aussagen.

Der wichtigste Punkt für das Verständnis der Chatbot Geschichte: ELIZA und PARRY waren Konversationssimulatoren, keine Problemlöser. Ihr Ziel war es, Menschen zu täuschen – nicht, ihnen tatsächlich zu helfen. Diese Einschränkungen machten deutlich, dass für wirklich natürliche und nützliche Konversationen mit Maschinen fortschrittlichere Technologien erforderlich waren.

Der KI-Winter und erste kommerzielle Versuche (1980-2000)

Nach der anfänglichen Begeisterung für ELIZA und PARRY folgte eine Phase, die in der KI-Forschung als KI-Winter bekannt ist. Die Erwartungen an künstliche Intelligenz waren überzogen hoch gewesen, und als die Realität diese nicht erfüllte, versiegten Forschungsgelder und öffentliches Interesse. Für die Chatbot-Entwicklung bedeutete dies eine Zeit der Stagnation.

A.L.I.C.E. und die ersten Nutzbots

Ende der 1990er Jahre kam jedoch neuer Schwung in die Chatbot Geschichte. Ein Beispiel für den Einsatz fortschrittlicherer NLP-Techniken ist A.L.I.C.E. (Artificial Linguistic Internet Computer Entity), die 1995 entwickelt wurde. A.L.I.C.E. nutzte ein erweitertes Pattern-Matching-System namens AIML (Artificial Intelligence Markup Language), das kontinuierlich aktualisiert werden konnte, um die Konversationsfähigkeiten zu verbessern.

Ein weiteres bemerkenswertes Beispiel ist Jabberwacky, das 1997 online ging. Jabberwacky nutzte kontextbezogenes Pattern Matching, um natürlichere Gespräche zu ermöglichen und aus den Interaktionen mit Benutzern zu lernen. Dies war ein wichtiger Schritt in Richtung lernfähiger Chatbots.

SmarterChild: Der Chatbot einer Generation

Für viele Millennials war SmarterChild (2001) der erste Kontakt mit einem Chatbot. Dieser Bot war auf AOL Instant Messenger und MSN Messenger verfügbar und bot erstmals echten Nutzen: Wetterberichte, Sportergebnisse, Börseninformationen und sogar Wörterbuchfunktionen. SmarterChild war kein Konversationssimulator mehr – er war ein Vorläufer moderner Business-Bots.

Diese Phase markiert einen wichtigen Wendepunkt in der Chatbot Geschichte: den Übergang von Unterhaltung zu Nutzen. Chatbots wurden nicht mehr nur als Kuriosität betrachtet, sondern als potenzielle Werkzeuge für echte Aufgaben. Die kommerzielle Nutzung rückte in greifbare Nähe.

NLP revolutioniert die Chatbot-Technologie

Die Einführung von Natural Language Processing (NLP) markierte einen bedeutenden Fortschritt in der Entwicklung von Chatbots. Diese Technologie ermöglichte es den Systemen, menschliche Sprache besser zu verstehen und natürlicher zu kommunizieren.

NLP-Erweiterungen für moderne Chatbots

NLP bildet die Grundlage für das verbesserte Sprachverständnis moderner NLP Chatbots. Es ermöglicht ihnen, Kontext und Nuancen in der menschlichen Kommunikation zu erfassen. Anders als bei den frühen Pattern-Matching-Systemen können NLP-basierte Chatbots:

- Synonyme und verschiedene Formulierungen derselben Frage erkennen

- Rechtschreibfehler und Tippfehler tolerieren

- Die Absicht hinter einer Aussage verstehen (Intent Recognition)

- Entitäten wie Namen, Orte und Produkte automatisch extrahieren

Fortschritte im Sprachverständnis

Die Integration von NLP führte zu erheblichen Verbesserungen in der Antwortgenerierung von Chatbots. Sie konnten nun komplexere Satzstrukturen verstehen und kontextbezogene Antworten liefern. Diese Fortschritte im Sprachverständnis ermöglichten es Chatbots, flüssigere und kontextbezogenere Gespräche zu führen. Sie konnten nun besser auf die Absichten und Emotionen der Benutzer eingehen, was zu einer deutlich verbesserten Benutzererfahrung führte.

Die Ära der Assistenten und der Frustrations-Phase (2010-2018)

Die 2010er Jahre brachten einen regelrechten Hype um digitale Assistenten und Chatbots – aber auch eine Phase massiver Enttäuschung, die in der Chatbot Geschichte oft vergessen wird.

Die Explosion der mobilen Assistenten

Die Integration von Chatbots in Conversational AI-Plattformen hat zu leistungsfähigen virtuellen Assistenten geführt. Einige der bekanntesten Beispiele sind:

- Siri: 2010 von Apple eingeführt, revolutionierte Siri die Art und Weise, wie wir mit unseren Geräten interagieren

- Google Now: 2012 gestartet, bot Google Now kontextbezogene Informationen basierend auf Nutzergewohnheiten und -präferenzen

- Alexa: 2014 von Amazon vorgestellt, etablierte Alexa sich als führender sprachgesteuerter Assistent für Smart Home-Anwendungen

Diese Plattformen nutzten fortschrittliche KI-Technologien, um natürliche Gespräche zu führen und komplexe Aufgaben auszuführen. Unternehmen auf der ganzen Welt sahen das Potenzial und begannen, Chatbots massiv einzusetzen.

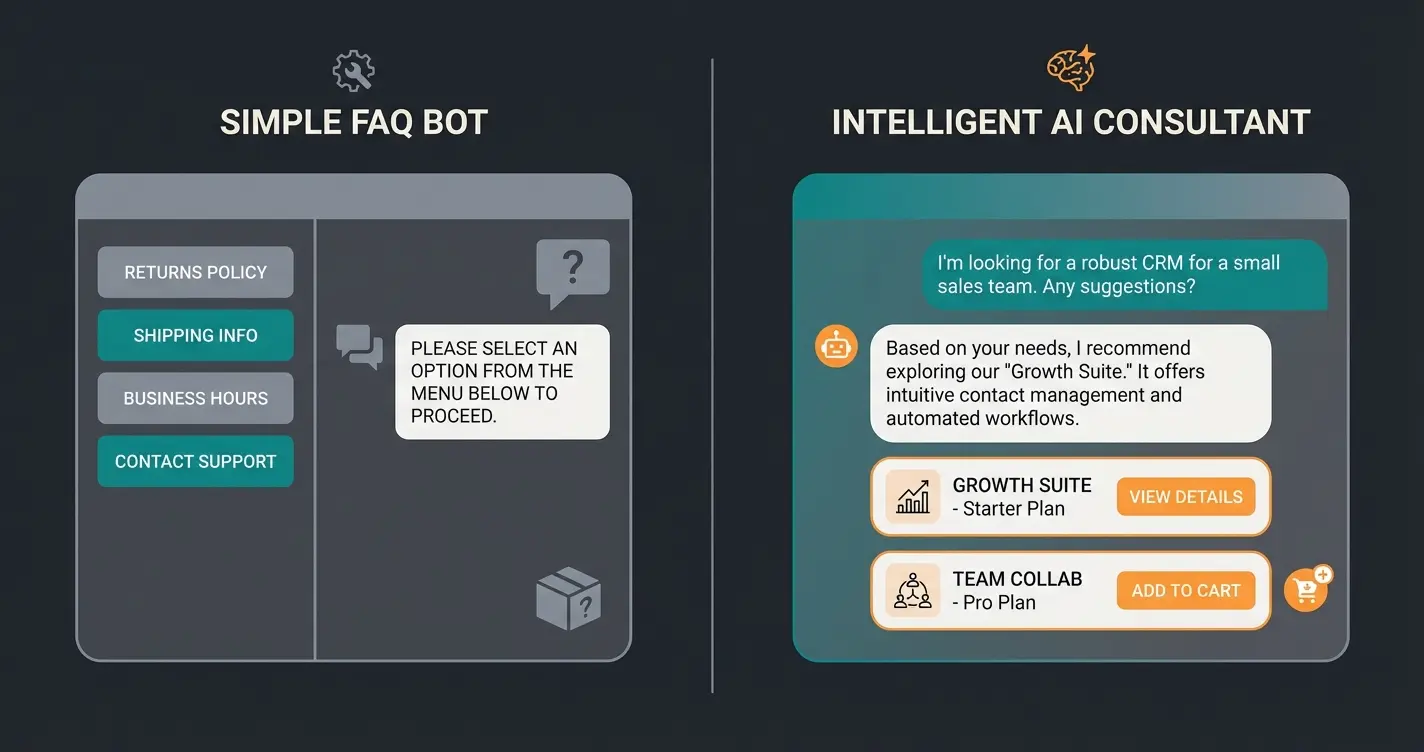

Das Problem: Die Button-Klick-Bots

Was dann folgte, war eine Welle von regelbasierten FAQ-Bots, die Websites und Messenger-Plattformen überfluteten. Diese Bots sahen auf den ersten Blick vielversprechend aus, führten aber zu massiver Nutzerfrustration:

- Starre Entscheidungsbäume: Nutzer mussten sich durch vorgegebene Button-Optionen klicken, statt frei zu formulieren

- Keine Flexibilität: Sobald eine Anfrage nicht zum vorprogrammierten Pfad passte, versagten die Bots

- Die *Ich verstehe dich nicht*-Schleife: Endlose Wiederholungen von Das habe ich leider nicht verstanden

- Keine echte Problemlösung: Diese Bots konnten nur zu FAQ-Artikeln weiterleiten, nicht wirklich helfen

Diese Phase ist wichtig für das Verständnis der Chatbot Geschichte, weil sie zeigt: Technologie allein reicht nicht. Die Button-Klick-Bots scheiterten nicht an mangelnder Technologie, sondern an falschen Erwartungen und mangelhafter Umsetzung. Sie wurden primär als Kostenspar-Maßnahme eingesetzt – um Kundensupport-Mitarbeiter zu ersetzen – statt als echte Verbesserung der Kundenerfahrung.

| Aspekt | 1966 (ELIZA) | 2015 (Regelbasiert) | 2024 (Generative KI) |

|---|---|---|---|

| Technologie | Keyword-Matching | Entscheidungsbäume | NLP + LLMs |

| Gedächtnis | Keines | Session-basiert | Kontextuell |

| Haupteinsatz | Unterhaltung/Experiment | Support/FAQ | Beratung & Verkauf |

| Flexibilität | Sehr gering | Gering | Sehr hoch |

| Lernfähigkeit | Keine | Keine | Kontinuierlich |

Machine Learning: Der Durchbruch zu selbstlernenden Chatbots

Der nächste große Sprung in der Chatbot-Technologie kam mit der Integration von Machine Learning. Diese Entwicklung führte zu Machine Learning Chatbots, die aus Interaktionen lernen und ihre Leistung kontinuierlich verbessern konnten.

Integration von Machine Learning in Chatbots

Machine Learning ermöglicht es Chatbots, aus Daten zu lernen und ihre Leistung im Laufe der Zeit zu verbessern. Die Grundprinzipien des maschinellen Lernens in Chatbots umfassen:

- Mustererkennung: Identifizierung wiederkehrender Strukturen in Benutzereingaben

- Vorhersagemodelle: Entwicklung von Algorithmen zur Vorhersage geeigneter Antworten

- Kontinuierliches Lernen: Anpassung und Verbesserung basierend auf neuen Interaktionen

Durch die Analyse von Benutzerinteraktionen können ML-basierte Chatbots ihre Antworten und Empfehlungen verfeinern. Dies führt zu einer präziseren und relevanteren Beratung, wie sie beispielsweise in der KI-gestützten Produktberatung eingesetzt wird.

Steigerung von Genauigkeit und Relevanz

Machine Learning ermöglicht Chatbots eine verbesserte Anpassungsfähigkeit an verschiedene Gesprächskontexte. Sie können nun:

- Kontextverständnis: Den Gesprächsverlauf berücksichtigen und kontextbezogene Antworten geben

- Personalisierung: Individuelle Vorlieben und Verhaltensweisen der Benutzer lernen und berücksichtigen

- Sprachanpassung: Den Kommunikationsstil an den jeweiligen Benutzer anpassen

Frühe ML-basierte Chatbots zeigten bereits beeindruckende Fähigkeiten in der Verarbeitung natürlicher Sprache und der Generierung relevanter Antworten. Sie konnten komplexere Anfragen bearbeiten und lernten kontinuierlich aus jeder Interaktion, um ihre Leistung zu verbessern.

Die Integration von Machine Learning in Chatbots markierte einen Wendepunkt in der Entwicklung dieser Technologie. Sie ebnete den Weg für die heutigen hochentwickelten KI Chatbots, die in der Lage sind, menschenähnliche Gespräche zu führen und komplexe Aufgaben zu bewältigen.

Moderne KI-Produktberater gehen weit über FAQ-Bots hinaus. Sie verstehen deine Kunden, beraten individuell und steigern nachweislich die Conversion Rate.

Jetzt kostenlos testenDeep Learning und neuronale Netze in Chatbots

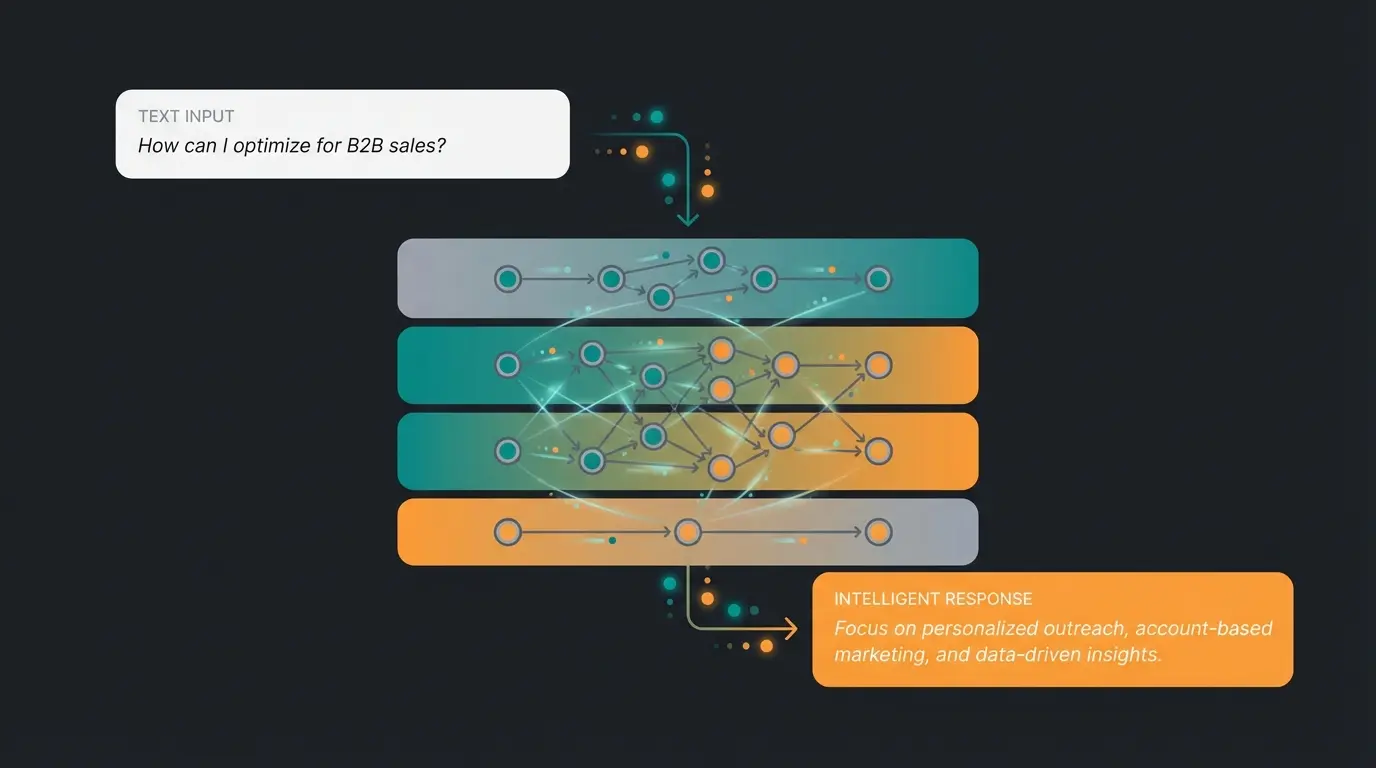

Die Integration von Deep Learning und neuronalen Netzen markiert einen weiteren Wendepunkt in der Entwicklung von Chatbots. Diese fortschrittlichen Technologien ermöglichen es Chatbots, komplexe Sprachmuster zu erkennen und kontextbezogene Antworten zu generieren.

Fortschritte in der Sprachverarbeitung

Deep Learning-Algorithmen und neuronale Netze bilden die Grundlage für signifikante Verbesserungen in der Sprachverarbeitung von Chatbots. Diese Technologien ermöglichen es den Systemen, natürliche Sprache auf einem neuen Niveau zu verstehen und zu generieren.

Einige der Hauptvorteile dieser Technologien sind:

- Kontextverständnis: Verbesserte Fähigkeit, den Kontext einer Konversation zu erfassen und zu berücksichtigen

- Spracherkennung: Genauere Interpretation von Nuancen und Mehrdeutigkeiten in der menschlichen Sprache

- Antwortgenerierung: Erzeugung natürlicherer und flüssigerer Antworten

Komplexe und kontextbezogene Konversationen

Mit der Einführung von Deep Learning-basierten Chatbots hat sich die Qualität der Konversationen deutlich verbessert. Ein herausragendes Beispiel dafür ist Mitsuku, ein Chatbot, der mehrfach den Loebner-Preis für die menschenähnlichste Konversation gewonnen hat.

Mitsuku demonstriert beeindruckende Fähigkeiten in:

- Kontexterhaltung: Führen längerer, zusammenhängender Gespräche über viele Nachrichten hinweg

- Persönlichkeit: Konsistente Darstellung einer einzigartigen Persönlichkeit mit Humor und Eigenarten

- Wissensanwendung: Fähigkeit, Informationen aus verschiedenen Bereichen in Gesprächen anzuwenden

Diese Fortschritte zeigen, wie weit sich Chatbots von ihren frühen, regelbasierten Vorläufern entfernt haben. Sie können nun Gespräche führen, die in ihrer Komplexität und Natürlichkeit denen von Menschen ähneln.

Die Revolution: Generative KI und LLMs (Ab 2020)

Große Sprachmodelle wie GPT

Die jüngste Revolution in der Chatbot-Technologie wurde durch die Einführung großer Sprachmodelle wie GPT (Generative Pre-trained Transformer) eingeleitet. Diese KI-Systeme haben die Fähigkeiten von Chatbots auf ein völlig neues Niveau gehoben. GPT-basierte Chatbots zeichnen sich durch ein tiefgreifendes Verständnis natürlicher Sprache und die Fähigkeit aus, kontextbezogene und kohärente Antworten zu generieren.

Ein Meilenstein in dieser Entwicklung war die Einführung von ChatGPT im Jahr 2022. Dieses Modell demonstrierte eindrucksvoll, wie weit die KI-Technologie in der Lage ist, menschenähnliche Konversationen zu führen. ChatGPT kann nicht nur Fragen beantworten, sondern auch komplexe Themen erklären, kreative Inhalte generieren und sogar bei der Problemlösung unterstützen.

Die Vorteile von GPT-basierten Chatbots sind vielfältig:

- Flexibilität: Sie können sich an verschiedene Gesprächsthemen und -stile anpassen.

- Kontextverständnis: Sie behalten den Kontext über mehrere Nachrichten hinweg bei.

- Lernfähigkeit: Sie können aus neuen Interaktionen lernen und sich kontinuierlich verbessern.

- Kreativität: Sie können neue Inhalte generieren, nicht nur vorhandene wiedergeben.

Die Entwicklung dieser Technologie schreitet rasant voran. Zukünftige Versionen wie GPT-5 versprechen noch leistungsfähigere und vielseitigere Chatbots, die die Grenze zwischen künstlicher und menschlicher Intelligenz weiter verwischen werden.

Der entscheidende Unterschied zu früheren Chatbot-Generationen: Generative KI versteht Sprache nicht nur – sie kann sie aktiv und kreativ nutzen. Der Wechsel von Keyword-Matching zu Intent-Verständnis war der größte Sprung in der gesamten Chatbot Geschichte.

Multimodale KI-Systeme

Ein weiterer zukunftsweisender Trend in der Chatbot-Technologie sind multimodale KI-Systeme. Diese Systeme gehen über reine Textverarbeitung hinaus und integrieren verschiedene Eingabeformen wie Text, Sprache und visuelle Daten. Dies ermöglicht eine umfassendere und natürlichere Interaktion zwischen Mensch und Maschine.

Multimodale Chatbots können beispielsweise:

- Spracherkennung: Gesprochene Befehle verstehen und darauf reagieren.

- Bildanalyse: Visuelle Informationen verarbeiten und in die Konversation einbeziehen.

- Gestenerkennung: Non-verbale Kommunikation interpretieren und darauf reagieren.

Die Integration dieser Technologien eröffnet neue Möglichkeiten für Chatbots in verschiedenen Anwendungsbereichen. In der Kundenbetreuung können sie beispielsweise Produktbilder analysieren und spezifische Empfehlungen geben. Im E-Commerce könnten Kunden ein Foto von einem Produkt hochladen und der Chatbot findet ähnliche Artikel im Sortiment.

Die Zukunft der multimodalen Chatbots verspricht eine noch intuitivere und menschenähnlichere Interaktion. Sie werden in der Lage sein, subtile Nuancen in Sprache und Verhalten zu erfassen und darauf angemessen zu reagieren, was zu einer deutlich verbesserten Benutzererfahrung führt.

ELIZA konnte nur Schlüsselwörter erkennen

50 Millionen Nutzer auf AOL und MSN

100 Millionen Nutzer in 2 Monaten

Moderne KI erkennt Nutzerabsichten präzise

Die Zukunft ist jetzt: Vom Support-Bot zum Produkt-Berater

Dies ist der vielleicht wichtigste Abschnitt für das Verständnis der modernen Chatbot Geschichte: Der Wandel von reaktiven Support-Bots zu proaktiven Beratern und Verkäufern.

Der Paradigmenwechsel in der Chatbot-Nutzung

Jahrzehntelang wurden Chatbots primär für einen Zweck eingesetzt: Kosten sparen. Sie sollten Support-Mitarbeiter ersetzen, FAQ-Anfragen abfangen und das Ticket-Volumen reduzieren. Der KI-Chatbot vs Mitarbeiter-Vergleich zeigt, wie sich dieses Verhältnis grundlegend gewandelt hat. Diese Denkweise führte zu den frustrierenden Button-Bots der 2010er Jahre.

Heute findet ein fundamentaler Wandel statt: Moderne Conversational AI wird nicht mehr nur eingesetzt, um Kosten zu sparen, sondern um Umsatz zu generieren. Der Chatbot entwickelt sich vom Bibliothekar (der nur Informationen abruft) zum aktiven Verkaufsberater. Ein gutes Beispiel für diesen Wandel ist der Produktfinder vs Chatbot-Vergleich.

Ein praktisches Beispiel verdeutlicht den Unterschied:

- Früher (Support-Bot): Wie lauten die Rückgabebedingungen? → Bot verlinkt auf FAQ-Artikel

- Heute (Produkt-Berater): Ich suche eine Feuchtigkeitscreme für trockene Haut → Bot fragt nach Hauttyp, Allergien, Preisvorstellung und empfiehlt dann das perfekte Produkt aus dem Sortiment

Warum Produktberatung der nächste große Schritt ist

Die Fähigkeit, Kunden aktiv zu beraten und beim Kaufprozess zu unterstützen, ist der logische nächste Schritt in der Chatbot Evolution. KI-Chatbots revolutionieren die Kundeninteraktion, indem sie:

- Bedarfsanalyse durchführen: Gezielte Fragen stellen, um die Kundenbedürfnisse zu verstehen

- Produktwissen nutzen: Aus tausenden Produkten das passende auswählen

- Entscheidungshilfe bieten: Komplexe Kaufentscheidungen vereinfachen

- Cross-Selling optimieren: Ergänzende Produkte intelligent vorschlagen

Der KI-Chatbot von heute repliziert nicht mehr nur einen Support-Mitarbeiter – er repliziert den erfahrenen Verkäufer im Fachgeschäft, der zuhört, versteht und die perfekte Empfehlung gibt.

Auswirkungen auf Unternehmen und Kunden

Auswirkungen auf Unternehmen und Kunden

Verbesserung der Kundenerfahrung

Die Evolution der Chatbot-Technologie hat tiefgreifende Auswirkungen auf die Kundenerfahrung. Moderne KI-gestützte Chatbots bieten eine Reihe von Vorteilen, die die Interaktion zwischen Unternehmen und Kunden grundlegend verändern:

- Verfügbarkeit: 24/7-Service ohne Wartezeiten oder Einschränkungen durch Geschäftszeiten.

- Schnelligkeit: Sofortige Antworten auf Kundenanfragen, was die Zufriedenheit erhöht.

- Konsistenz: Gleichbleibende Qualität der Antworten, unabhängig von Tageszeit oder Arbeitsbelastung.

- Personalisierung: Individuelle Beratung basierend auf Kundenpräferenzen und -historie.

KI-Chatbots revolutionieren die Kundeninteraktion durch ihre Fähigkeit, große Mengen an Kundendaten zu analysieren und zu nutzen. Dies ermöglicht eine hochgradig personalisierte Beratung und maßgeschneiderte Produktempfehlungen. Kunden erhalten relevante Informationen und Lösungen, die auf ihre individuellen Bedürfnisse zugeschnitten sind, was zu einer deutlich verbesserten Kundenzufriedenheit führt.

Effizienzsteigerung für Unternehmen

Für Unternehmen bieten moderne Chatbots erhebliche Vorteile in Bezug auf Effizienz und Kostenoptimierung:

- Automatisierung: Routineaufgaben und häufig gestellte Fragen werden automatisch bearbeitet.

- Skalierbarkeit: Bewältigung hoher Anfragevolumina ohne zusätzliches Personal.

- Datensammlung: Kontinuierliche Erfassung wertvoller Kundeneinblicke für Geschäftsentscheidungen.

- Umsatzsteigerung: Proaktive Produktberatung erhöht Conversion Rates und Warenkorbwerte.

Durch die Übernahme repetitiver Aufgaben durch KI-Chatbots wird das Kundenservice-Personal entlastet und kann sich auf komplexere, wertschöpfende Aufgaben konzentrieren. Dies führt nicht nur zu einer Kosteneinsparung, sondern auch zu einer Steigerung der Mitarbeiterzufriedenheit und -produktivität.

Zudem ermöglichen die von Chatbots gesammelten Daten Unternehmen, Kundentrends und -präferenzen besser zu verstehen. Diese Erkenntnisse können für die Verbesserung von Produkten, Dienstleistungen und Marketingstrategien genutzt werden, was letztlich zu einer Steigerung der Kundenbindung und des Unternehmenserfolgs führt.

Fazit: Was wir aus der Chatbot Geschichte lernen können

Die Chatbot Geschichte zeigt eindrucksvoll, wie rasant sich Technologie entwickeln kann – und wie wichtig es ist, nicht nur technologische Fortschritte zu machen, sondern diese auch sinnvoll einzusetzen. Von ELIZAs simplem Pattern-Matching über die frustrierenden FAQ-Bots der 2010er Jahre bis hin zu den intelligenten KI-Beratern von heute war es ein weiter Weg.

Die wichtigsten Erkenntnisse aus dieser Evolution:

- Technologie allein reicht nicht: Die Button-Bots scheiterten nicht an mangelnder Technologie, sondern an falscher Implementierung

- Vom Kostenspar-Tool zum Umsatztreiber: Die erfolgreichsten Chatbots werden heute nicht zur Kostensenkung, sondern zur Umsatzsteigerung eingesetzt

- Der Mensch im Mittelpunkt: Erfolgreiche Chatbots imitieren nicht nur Gespräche – sie lösen echte Probleme

- Kontinuierliche Evolution: Die Entwicklung steht nicht still – wer heute nicht in moderne KI investiert, wird morgen den Anschluss verlieren

Die Zukunft gehört Chatbots, die nicht nur Fragen beantworten, sondern aktiv beraten, empfehlen und verkaufen. Unternehmen, die diese neue Generation von KI-Assistenten effektiv nutzen, automatisieren nicht nur ihren Support – sie transformieren ihr gesamtes Kundenerlebnis.

Häufige Fragen zur Chatbot Geschichte

Der erste Chatbot, ELIZA, wurde 1966 von Joseph Weizenbaum am Massachusetts Institute of Technology (MIT) entwickelt. Weizenbaum war ein deutsch-amerikanischer Informatiker. ELIZA simulierte Gespräche mit einem Psychotherapeuten, indem sie Schlüsselwörter erkannte und darauf basierend vorgefertigte Antworten gab.

Regelbasierte Chatbots folgen vordefinierten Entscheidungsbäumen und können nur auf explizit programmierte Eingaben reagieren. KI-basierte Chatbots nutzen Machine Learning und Natural Language Processing, um Sprache zu verstehen, aus Interaktionen zu lernen und flexible, kontextbezogene Antworten zu generieren – auch bei Formulierungen, die nicht exakt vorprogrammiert wurden.

In dieser Phase setzten viele Unternehmen regelbasierte FAQ-Bots ein, die nur über Button-Klicks navigiert werden konnten. Sie hatten kein echtes Sprachverständnis und reagierten auf unvorhergesehene Eingaben mit Ich verstehe dich nicht-Schleifen. Diese Bots wurden primär als Kostenspar-Maßnahme eingesetzt, nicht als echte Verbesserung der Kundenerfahrung.

ChatGPT basiert auf einem Large Language Model (LLM), das auf riesigen Textmengen trainiert wurde. Anders als frühere Chatbots versteht ChatGPT Kontext über mehrere Nachrichten hinweg, kann kreative Inhalte generieren und passt seinen Kommunikationsstil an den Nutzer an. Der Wechsel von Keyword-Matching zu echtem Sprachverständnis war revolutionär.

Die Zukunft gehört KI-Produktberatern, die nicht nur Fragen beantworten, sondern aktiv beim Kaufprozess unterstützen. Sie analysieren Kundenbedürfnisse, empfehlen passende Produkte aus dem Sortiment und führen Kunden durch komplexe Kaufentscheidungen – ähnlich wie ein erfahrener Verkäufer im Fachgeschäft.

Entdecke, wie moderne KI-Produktberater deine Conversion Rate steigern und deinen Kunden ein personalisiertes Einkaufserlebnis bieten können.

Kostenlos starten

Lasse ist CEO und Mitgründer von Qualimero. Nach seinem MBA an der WHU und dem Aufbau eines Unternehmens auf siebenstellige Umsätze gründete er Qualimero, um KI-gestützte digitale Mitarbeiter für den E-Commerce zu entwickeln. Sein Fokus: Unternehmen dabei unterstützen, Kundeninteraktion durch intelligente Automatisierung messbar zu verbessern.