WhatsApp KI Datenschutz: Risiken, Deaktivierung & Alternativen

WhatsApp KI Datenschutz: Erfahre die Risiken von Meta AI, wie du die KI deaktivierst und sichere Alternativen für Unternehmen nutzt. DSGVO-konform!

Einleitung: Der blaue Kreis und das Ende der Privatsphäre?

Es begann mit einem unscheinbaren Update. Plötzlich war er da: Ein kleiner, schillernder blauer Kreis in der Chat-Übersicht oder direkt über dem Neuer Chat-Button. Für Millionen von WhatsApp-Nutzern in Deutschland und Europa markierte dieses Symbol den Einzug von Meta AI in ihren privatesten Kommunikationskanal. Was als nützliches Feature für Rezeptvorschläge oder schnelle Web-Recherchen beworben wird, löst bei Datenschützern und IT-Verantwortlichen in Unternehmen Alarmstufe Rot aus.

Die zentrale Frage, die sich derzeit jeder stellt, lautet: Wie steht es um WhatsApp KI Datenschutz? Liest Meta jetzt meine Nachrichten mit? Werden meine Firmengeheimnisse genutzt, um das nächste Sprachmodell zu trainieren? Die Realität ist komplex. Während Meta laut whatsapp.com beteuert, private Nachrichten blieben privat, sieht die technische Architektur der KI-Chats ganz anders aus.

Für Privatnutzer ist das ärgerlich, für Unternehmen kann es existenzbedrohend sein. In diesem Artikel analysieren wir nicht nur die Risiken und zeigen dir, wie du die WhatsApp KI deaktivieren kannst (bzw. einschränken), sondern wir beleuchten vor allem den Blue Ocean für Unternehmen: Wie du die Effizienz von KI nutzen kannst, ohne deine Datenhoheit an einen US-Konzern abzutreten. Wenn du dich für WhatsApp Datenschutz Unternehmen interessierst, findest du dort noch tiefere Einblicke in die rechtlichen Anforderungen.

Wie sicher ist Meta AI auf WhatsApp wirklich?

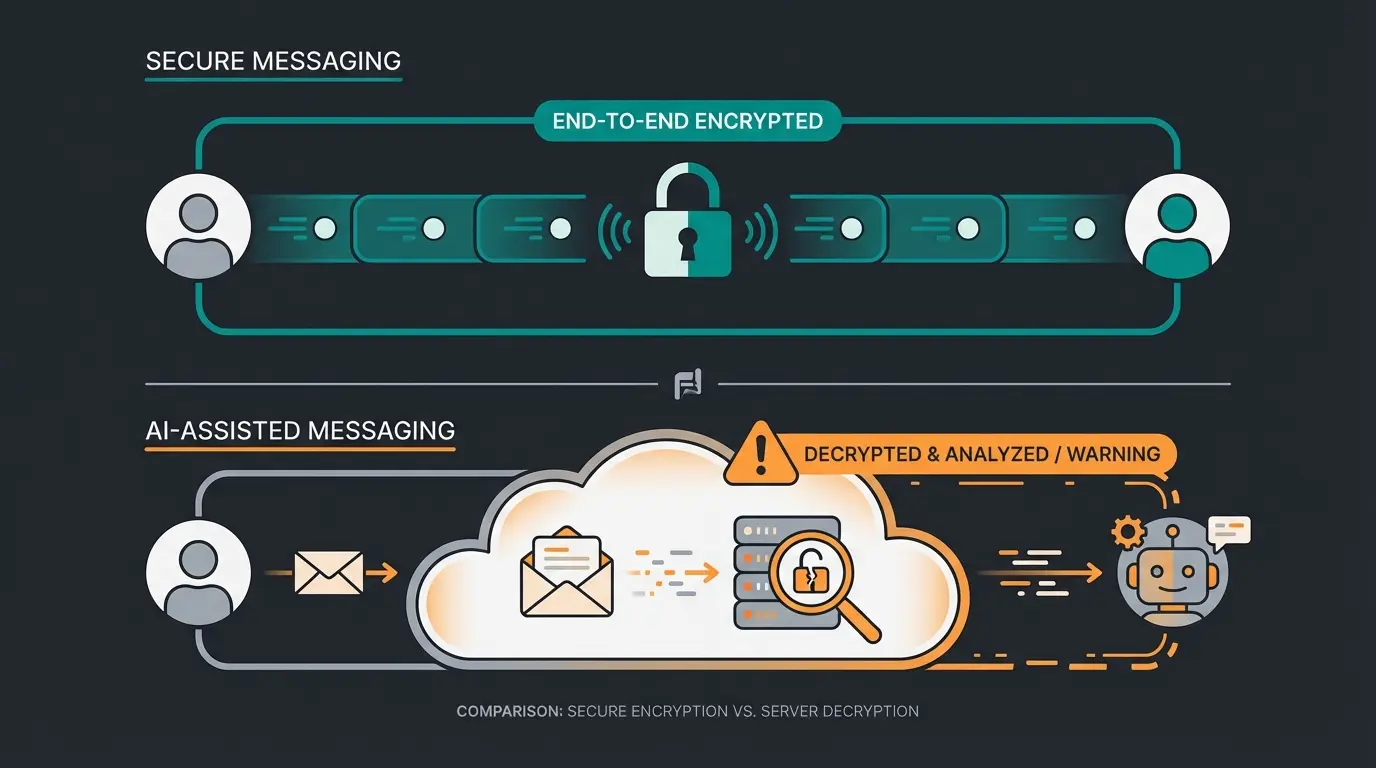

Um die Risiken beim WhatsApp Meta AI Datenschutz zu verstehen, müssen wir zunächst mit einem weit verbreiteten Missverständnis aufräumen: dem Mythos der durchgehenden Verschlüsselung bei KI-Interaktionen.

Das Ende der Ende-zu-Ende-Verschlüsselung in KI-Chats

WhatsApp wurde groß mit dem Versprechen der Ende-zu-Ende-Verschlüsselung (E2E). Das bedeutet technisch: Nachricht A wird auf deinem Handy verschlüsselt und erst auf dem Handy des Empfängers wieder entschlüsselt. Selbst WhatsApp (und damit Meta) kann den Inhalt dazwischen nicht lesen, da sie den Schlüssel nicht besitzen.

Wie cybersofa.ch ausführlich dokumentiert, funktioniert die Datenverarbeitung bei Meta AI folgendermaßen:

- Transportverschlüsselung: Die Nachricht wird zwar verschlüsselt an den Server gesendet (niemand im WLAN kann mitlesen)

- Server-seitige Entschlüsselung: Damit die KI antworten kann, MUSS die Nachricht auf den Meta-Servern (meist in den USA) entschlüsselt und im Klartext verarbeitet werden

- Verarbeitung: Das Sprachmodell (LLM) analysiert den Text, um eine Antwort zu generieren

Das bedeutet: Meta liest mit. Zwar beteuert das Unternehmen, diese Daten nur zur Verbesserung der Dienste zu nutzen, doch genau hier liegt der Hund begraben. Für Unternehmen, die Shopware Datenschutz DSGVO-konform arbeiten wollen, ist das ein echtes Problem.

Berechtigtes Interesse: Wie Meta deine Daten trainiert

Meta stützt sich bei der Verarbeitung von Nutzerdaten für das KI-Training auf das sogenannte Berechtigte Interesse (Art. 6 Abs. 1 lit. f DSGVO). Das ist ein juristischer Kniff, wie die ombudsstelle.at erklärt. Anstatt jeden Nutzer explizit um Erlaubnis zu fragen (Opt-in), nimmt Meta an, dass das Training der KI im Interesse des Unternehmens liegt und die Rechte der Nutzer nicht überwiegt.

Welche Daten werden gesammelt? Laut fb.com umfasst dies folgende Kategorien:

- Prompts & Eingaben: Alles, was du der KI schreibst

- Feedback: Wie du auf die Antworten reagierst

- Metadaten: Wann und wie oft du die KI nutzt

- Öffentliche Daten: Meta hat angekündigt, öffentliche Beiträge von Facebook und Instagram für das Training zu nutzen, um den Kontext für die WhatsApp-KI zu verbessern

Wie iamexpat.de berichtet, ist dies für Unternehmen ein absolutes No-Go. Wenn ein Mitarbeiter aus Bequemlichkeit die Meta AI fragt: Fasse mir dieses Meeting-Protokoll zusammen oder Schreibe eine Antwort auf diese Kundenbeschwerde, landen interne Firmendaten direkt im Trainings-Pool eines US-Konzerns.

Meta AI Gespräche werden auf Servern entschlüsselt

Verarbeitung auf Meta-Servern außerhalb der EU

Du kannst dem KI-Training widersprechen

Verschärfte Anforderungen für Business-Bots

Anleitung: Meta AI Datenverarbeitung widersprechen

Viele Nutzer suchen verzweifelt nach einem Weg, die WhatsApp KI deaktivieren zu können und den blauen Kreis zu entfernen. Wie focus.de berichtet, gibt es hier zunächst schlechte Nachrichten: Eine vollständige Deaktivierung der UI-Elemente ist in den aktuellen Versionen der App oft nicht vorgesehen. Meta möchte, dass du die KI nutzt.

Wie auch tech-now.io bestätigt, gibt es aber eine gute Nachricht: Du kannst der Nutzung deiner Daten für das KI-Training widersprechen. Dies ist dein gutes Recht nach der DSGVO (Art. 21).

Der Weg zum versteckten Widerspruchs-Formular

Meta hat das Formular tief in den Menüs versteckt. Laut verbraucherzentrale.de ist hier der direkte Weg (Stand Ende 2025):

Öffne WhatsApp und gehe in die Einstellungen über das Drei-Punkte-Menü

Tippe auf 'Hilfe' und dann auf 'Hilfe-Center'

Suche nach 'KI' oder 'Datenschutz' und scrolle zu den rechtlichen Hinweisen

Suche den Punkt 'Wie kann ich der Verarbeitung meiner Informationen widersprechen?'

Fülle das externe Formular auf der Meta-Website aus und verifiziere deine Handynummer

Cheat Sheet: Textvorlage für den Widerspruch

Im Formular wirst du nach einer Begründung gefragt. Zwar ist diese laut DSGVO bei einem Widerspruch gegen Direktwerbung oder Profiling nicht zwingend, aber Meta verlangt oft eine Angabe, wie die Verarbeitung dich in deiner besonderen Situation beeinträchtigt. Nutze diese Vorlage, um deine Chancen zu maximieren:

Das Risiko für Unternehmen: Warum Meta AI nicht taugt

Während Privatnutzer nur ihre Privatsphäre riskieren, riskieren Unternehmen bei der Nutzung von Datenschutz WhatsApp KI-Verstöße, die Bußgelder in Millionenhöhe nach sich ziehen können. Wenn du bereits KI im Kundenservice einsetzt, solltest du diese Risiken genau kennen.

1. Der DSGVO-Albtraum

Sobald ein Mitarbeiter Meta AI auf seinem Diensthandy nutzt, verarbeitet er geschäftliche Daten über einen Server, der nicht unter der vollen Kontrolle des Unternehmens steht. Wie bolex.de und cookiebox.pro erklären, gibt es keinen Auftragsverarbeitungsvertrag (AVV) für die Nutzung der Consumer-KI im WhatsApp-Messenger, der den strengen deutschen Anforderungen genügt. Die Daten fließen in die USA. Zwar gibt es das Data Privacy Framework, doch für sensible Kundendaten ist die Rechtsunsicherheit massiv.

2. Das Halluzinations-Risiko (Brand Safety)

Meta AI ist ein Generalist. Es wurde mit dem ganzen Internet trainiert – nicht mit deinen spezifischen Produktdaten. Wer KI Chatbot im E-Commerce einsetzen möchte, muss dieses Risiko verstehen:

- Szenario: Ein Kunde fragt: Ist euer Produkt vegan?

- Meta AI Antwort: Ja, die meisten Produkte dieser Art sind vegan. (Basierend auf Wahrscheinlichkeiten, nicht auf deinem Produktdatenblatt)

- Realität: Dein Produkt enthält Bienenwachs

- Folge: Abmahnung, Kundenverlust, Shitstorm

Meta AI kennt deine spezifischen Produktdaten nicht. Es rät auf Basis von Trainingsdaten. Für professionelle Produktberatung ist das fatal.

3. Datenabfluss (Data Leakage)

Ähnlich wie beim Samsung-ChatGPT-Vorfall könnten Mitarbeiter versucht sein, Code-Schnipsel, Strategiepapiere oder Kundendaten in den Chat zu kopieren, um sie schnell zusammenfassen zu lassen. Diese Daten sind dann potenziell Teil des Meta-Wissensschatzes. Wenn du KI Kundenservice Automatisierung planst, musst du solche Szenarien von vornherein ausschließen.

Nutze eine DSGVO-konforme KI-Lösung, die deine Daten isoliert statt zu trainieren. Spezialisiert auf deine Produkte, gehostet auf deutschen Servern.

Jetzt sichere KI-Beratung testenConsumer AI vs. Professional AI: Der Unterschied

Hier liegt deine Blue Ocean-Chance. Der Markt versteht oft nicht, dass KI in WhatsApp nicht gleich Meta AI ist. Es gibt einen fundamentalen technischen und rechtlichen Unterschied zwischen dem Consumer-Bot und einer professionellen Business-Lösung. Wenn du bereits einen Shopware KI Guide gelesen hast, weißt du, wie wichtig diese Unterscheidung ist.

Vergleichstabelle: Meta AI vs. Professionelle KI-Lösung

| Feature | Meta AI (Consumer) | Professionelle KI-Lösung (Business API) |

|---|---|---|

| Zugang | Über die private WhatsApp App | Über WhatsApp Business API (Schnittstelle) |

| Datenbasis | Das gesamte Internet + User-Daten | NUR deine Unternehmensdaten (isolierter Silo) |

| Training | Lernt aus deinen Eingaben (Active Training) | KEIN Training mit Kundendaten (Static RAG) |

| Verschlüsselung | Transportverschlüsselung (Meta liest mit) | E2E bis zum Business-Provider (DSGVO-konform) |

| Kontrolle | Meta entscheidet, was die KI sagt | Du steuerst Tone of Voice und Wissen |

| Rechtssicherheit | Grauzone / Risiko | AVV möglich, Serverstandort DE/EU wählbar |

Visualisierung: Wohin fließen deine Daten?

Stell dir den Weg deiner Daten wie folgt vor – der Unterschied ist entscheidend für den WhatsApp KI Datenschutz in deinem Unternehmen:

Wie facebook.com in der offiziellen Business API Dokumentation erklärt, bietet diese Architektur echte Datensouveränität. Wer sich für KI im Vertrieb interessiert, findet dort weitere Anwendungsfälle.

So nutzt du KI sicher für Produktberatung in WhatsApp

Die Lösung ist nicht, KI zu verbieten, sondern die WhatsApp Business API in Kombination mit einer spezialisierten KI zu nutzen. Genau das macht eine WhatsApp AI Produktberatung möglich.

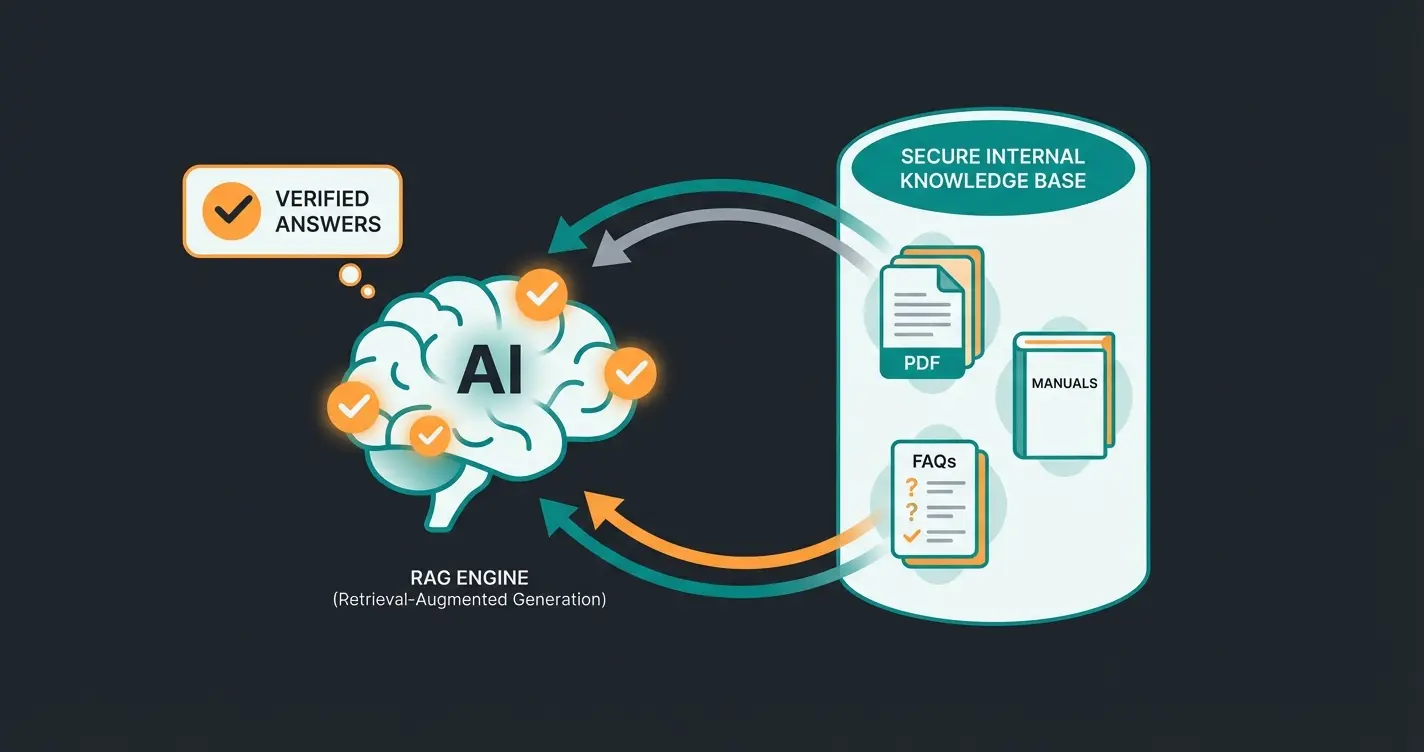

Die Technologie: RAG (Retrieval-Augmented Generation)

Statt eines Chatbots, der kreativ Texte erfindet (und halluziniert), nutzen professionelle Lösungen RAG. Diese Technologie ist fundamental anders als Consumer-KI:

- Der Kunde stellt eine Frage

- Die KI sucht ausschließlich in deinen hochgeladenen PDFs, Handbüchern und FAQs nach der Antwort

- Die KI formuliert die Antwort basierend auf diesen Fakten

- Findet sie keine Antwort in deinen Daten, sagt sie: Dazu habe ich keine Informationen, soll ich einen Mitarbeiter rufen?

Wenn du verstehen willst, wie der EU AI Act solche Systeme reguliert, solltest du auch die aktuellen rechtlichen Rahmenbedingungen kennen. Die KI Chatbots Regulierung wird ab 2026 noch strenger.

Schritt-für-Schritt zur sicheren KI-Beratung

Wie sofortdatenschutz.de empfiehlt, solltest du folgende Schritte beachten:

Nutze nicht die WhatsApp Business App auf dem Handy, sondern einen Business Solution Provider (BSP), der Zugriff auf die API bietet

Lade dein Produktwissen in eine sichere Umgebung (z.B. Vektordatenbank auf deutschen Servern)

Erstelle einen KI-Agenten mit strikten Anweisungen (System Prompt), niemals zu spekulieren

Verbinde den Agenten mit der WhatsApp API und teste die Antwortqualität

Der Clou: Wie green-api.com und ilkha.com berichten, verschärft WhatsApp ab 2026 die Regeln für die Business API. Allgemeine KI-Bots werden verbannt, erlaubt sind nur noch spezialisierte Service-Bots. Wer jetzt auf eine spezialisierte Lösung setzt, ist zukunftssicher aufgestellt. Du kannst WhatsApp Kundenservice nutzen, wenn du diese Richtlinien beachtest.

Wenn du bereits mit dem Gedanken spielst, einen WhatsApp Chatbot einsetzen zu wollen, ist jetzt der richtige Zeitpunkt zum Handeln.

Fazit & Checkliste für Datenschutz-Bewusste

Der blaue Kreis von Meta AI ist für Privatnutzer eine Spielerei, für Unternehmen jedoch eine Falle. Die Bequemlichkeit, mal eben die KI im Messenger zu fragen, wird mit dem Verlust der Datenhoheit bezahlt. Doch das bedeutet nicht, dass du auf KI verzichten musst. Der Schlüssel liegt in der Trennung von Infrastruktur (WhatsApp als Kanal) und Intelligenz (deine eigene KI).

Checkliste: Ist dein Unternehmen sicher?

- Mitarbeiter-Richtlinie: Ist die Nutzung von Meta AI auf Diensthandys explizit untersagt?

- Widerspruch: Hast du (und deine Mitarbeiter) dem KI-Training in den Privateinstellungen widersprochen?

- Kanal-Trennung: Nutzt du für Kundenkommunikation die WhatsApp Business API statt der App?

- Daten-Souveränität: Weißt du genau, auf welchen Servern deine KI-Antworten generiert werden?

Handele jetzt. Überlasse deine Kundendaten nicht dem Training von Meta. Setze auf eine professionelle KI-Lösung, die Datenschutz zur Priorität macht und deine Produkte wirklich versteht.

FAQ: Häufige Fragen zu WhatsApp KI & Datenschutz

Aktuell lässt sich das Icon in der Standard-App nicht vollständig entfernen, nur minimieren oder ignorieren. Der effektivste Schutz ist, nicht darauf zu klicken. Wenn du dem Training widersprichst, werden deine Daten zwar nicht mehr für das KI-Training verwendet, aber das UI-Element bleibt bestehen.

Meta gibt an, dass private Chats (Person zu Person) weiterhin E2E-verschlüsselt sind und nicht für das Training genutzt werden. Das Risiko entsteht erst bei der Interaktion mit der KI oder in Gruppen, in denen die KI aktiviert wurde. Sobald du aber mit Meta AI chattest, werden diese Inhalte verarbeitet.

Ja, bei korrekter Implementierung über seriöse Partner. Hier agiert Meta primär als Auftragsverarbeiter für den Transport, während die Datenverarbeitung in deiner kontrollierten Umgebung stattfindet. Du kannst einen AVV abschließen und den Serverstandort in Deutschland oder der EU wählen.

Meta AI ist ein generalistischer Chatbot, der mit Internetdaten trainiert wurde und aktiv aus Nutzerinteraktionen lernt. RAG-basierte Systeme hingegen greifen nur auf deine spezifischen Unternehmensdaten zu, spekulieren nicht und trainieren nicht mit Kundenanfragen. Das macht sie präziser und DSGVO-konformer.

Die Hauptrisiken sind: DSGVO-Verstöße durch fehlenden AVV und Datenübertragung in die USA, Halluzinationen die zu falschen Produktaussagen führen können, und Data Leakage wenn Mitarbeiter sensible Daten in den Chat eingeben. Bußgelder können in Millionenhöhe liegen.

Überlasse deine Kundendaten nicht dem Training von Meta. Mit unserer DSGVO-konformen Lösung nutzt du WhatsApp als Kanal – mit deiner eigenen KI auf deutschen Servern.

Kostenlos startenHaftungsausschluss: Dieser Artikel stellt keine Rechtsberatung dar. Datenschutzgesetze ändern sich schnell. Konsultiere für verbindliche Aussagen bitte deinen Datenschutzbeauftragten.

Lasse ist CEO und Mitgründer von Qualimero. Nach seinem MBA an der WHU und dem Aufbau eines Unternehmens auf siebenstellige Umsätze gründete er Qualimero, um KI-gestützte digitale Mitarbeiter für den E-Commerce zu entwickeln. Sein Fokus: Unternehmen dabei unterstützen, Kundeninteraktion durch intelligente Automatisierung messbar zu verbessern.